Az LM386-os integrált áramkör annyira elterjedt a hangerősítésben, hogy muszáj megértsük legalább az alapjait. Érdemes bő marékkal bevásárolni belőle, mert jó sokat el lehet füstölni, apró figyelmetlenségek miatt. Például nem tűri a tápfeszültség póluscseréjét.

Lábainak az ő kiosztásuk:

4 - a föld

6 - ide jön a 4-18V közötti táp (típusfüggő, nekünk LM386N-1 van, ami 4-12V feszültséget szeret), a kimenet hallhatóan nem változott a feszültség változtatgatásával a mi összeállításunkon sem, illetve a készen vásárolt modulokon sem.

2 - 3, a bejövő jel, szokták a 2. lábat a groundra kötni, de mi nem hallottunk különbséget azokban az áramkörökben, amiket összeraktunk.

5 -itt jön ki az erősített jel

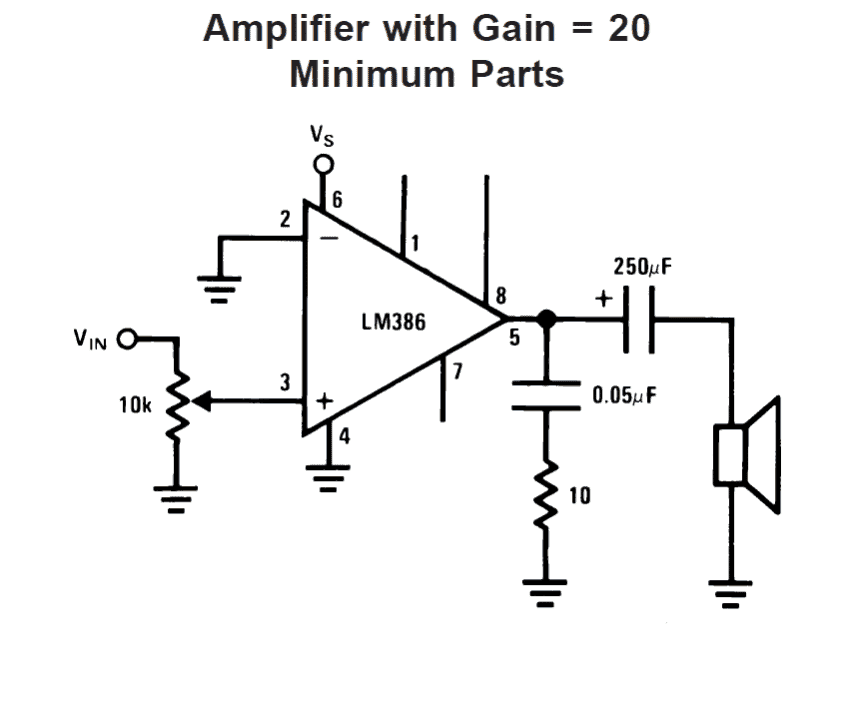

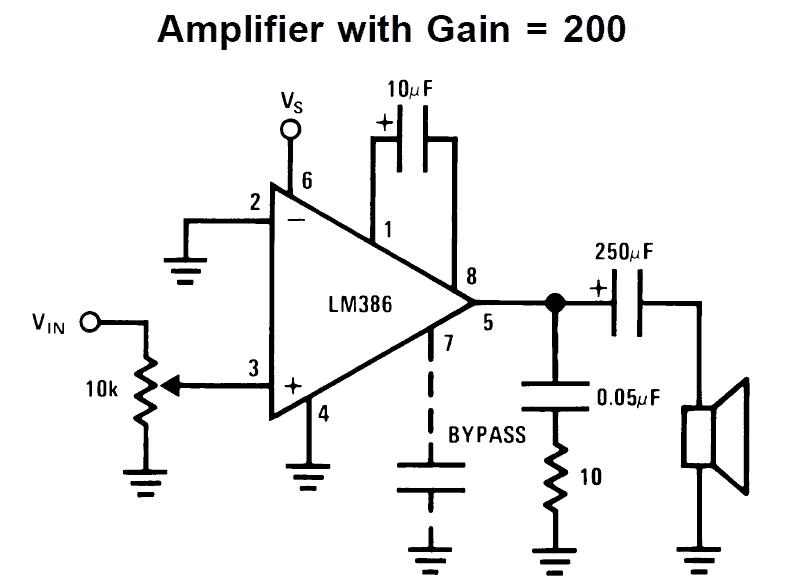

1-8, ha az 1-8 lábakat összekötjük, akkor 20X erősítés helyett 200X erősítést kapunk. Ezt a rajzokon egy kondenzátorral szokták megoldani, + ide jöhet egy potméter is, amivel az erősítés állíthatóvá válik.

Ezt szemléltetik itt:

A 20 és a 200 szoros erősítés között mi nem hallottuk a 10-es szorzót, nyilván kimérni meg nem tudjuk, mert nem értünk hozzá, meg nincs is amivel.

7 - ezt zajszűrésre használják, kondenzátorral a groundra kötve, de a mi cuccunkon ennek a hatását nem tudtuk kihallani.

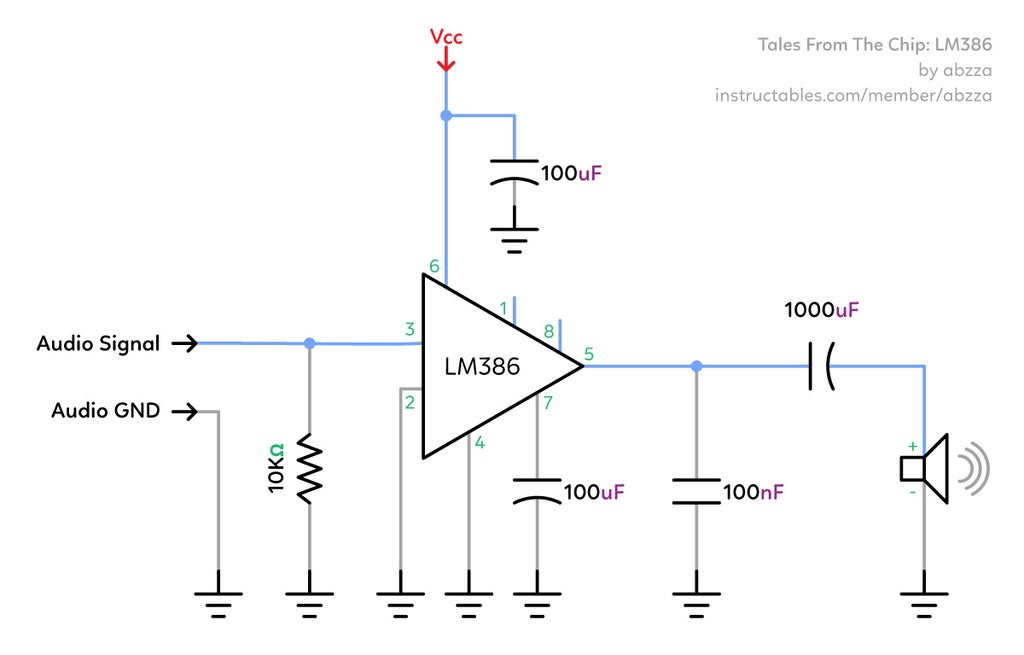

Egy bézikebb setupot próbálunk először, az Instructablesről.

Az audió bemenetet a telefon szolgáltatta, ami nyilván előerősített jel, a kimeneten nagyon gazdag basszusok, és észrevehetetlen zaj jelentkezett. Gitárkábel bemenettel is szép tiszta hangot kapunk. Azonban ha az 1-8 lábakat zárjuk, akkor erős overdrive (?) hangzásunk lesz, sajnos erős hálózati (?) zúgással együtt. Elemről valamivel jobb a helyzet, azonban ha kifogyóban van az elem, akkor a hang szakadozik, pattog.

Ha vérszemet kapnánk, akkor itt a circuitbasics cucca, ahol lépésről lépésre bonyolítja az LM386-os erősítőt a legegyszerűbbtől a három potméteres bonyolultig (videó, rajz).

Sajnos a kínai alkatrészeket a kínai alkatrész-detektor elég nagy szórással azonosította a névlegeshez képest, ezért nem tudjuk, hogy mennyire ezen múlik a hangzás. Azt is olvastuk, hogy a jó minőség érdekében az alkatrészek a lehető legközelebb kellene legyenek az IC-hez, nekünk meg olyan az összeállításunk, mint egy sündisznó. Mindenesetre az előzőnél jobb a hangzás, és főleg állítható a bemenet is (gitár esetén erre semmi szükség, a full jel is épp csak elég), illetve az erősítés is. A basszus állítgatása nem tűnt meggyőzőnek, nem hallottuk értelmét. De ez lehet, ha a szedett-vedett alkatrészek miatt van.

Ebben a videóban elég jól elmagyarázzák mi mit okoz az áramkörben, ezeket érdemes kipróbálgatni, változtatni. Nekünk egyelőre ennyi elég volt a kalandozásból, nagyon nagy apokalipszis kellene ahhoz, hogy ilyen erősítőt építsünk és használjunk élesben. Meg akkora apokalipszis után, áramunk se nagyon lenne.