Semmi örök, de ezt a bejegyzést úgy nézzétek meg, hogy nem tudni mikor szűnik meg benne a lényeg, ugyanis nem is hinnéd mennyire nem egyszerű úgy online tartani egy filet, hogy az direkt és nem változó linkkel elérhető legyen. Márpedig ennek a scriptnek olyan direkt elérés kell egy vieófilehoz, amit alig tudtunk megoldani. Végül innen a dropboxos választ tudtuk használni. Úgyhogy sokkal több időt veszítettünk a logisztikai problémákkal, mint magával a Chaoscollective lightfield játékával. Az alábbi képen oda állíthatsz éleset ahová csak kattintasz.

Click anywhere to adjust the focus.

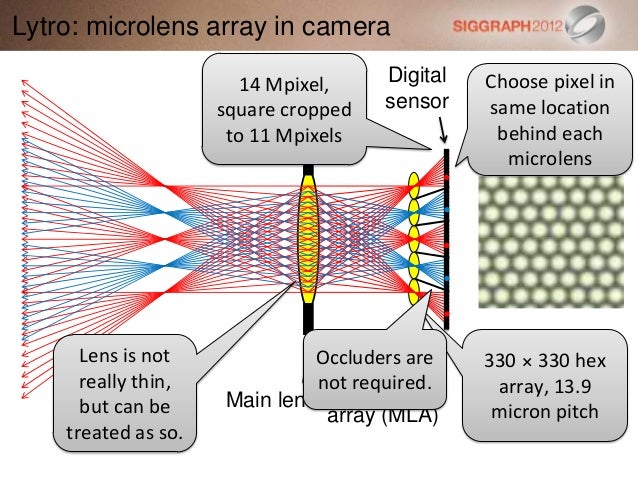

A módszer a Lytro kamera utólagos fókuszválasztását szimulálja bármilyen fényképezőgéppel készített videóból (na jó, nekünk még konvertálnunk is kellett a Nikon AVI-ját, mert nem HTML-kompatibilis, illetve meg is kellett trimmeljük kicsit az elejét és végét). A videónak egy lassú átfókuszálást kell tartalmaznia, tapasztalat szerint az sem baj, ha csöppet berezdül a gép a kézi élességállítástól. A chaoscollective ebből a videóból aztán egy mélységtérképet készít, illetve interaktívvá teszi azt. A hatásfok nem túl jó, volt, hogy ugyanabból a videóból nem készített semmit, másodszorra pedig megcsinálta. Aztán nem mindegyiket sikerül jól feltérképezni. Szóval ne adjátok fel, ha elsőre nem sikerül.

Ha végül sikerült, egy skriptet kapunk, ezt lehet beágyazni a saját oldalunkra, de ami a videóállománnyal együtt működik csak, és mint már említettem sok felhőalkalmazás linkjén egyszerűen nem látszik a videó, vagy ha igen, akkor dinamikusan változik a link.

Lett volna még pár beállítás, de a fejem is megfájdult ettől a marhaságtól, ha tudom, mennyi macera, neki se fogok. Na jó, még egyet, hogy lássátok mennyire esetlegesen végzi a dolgát ez a DOF motor. Itt egyáltalán nem sikerült a plánokat észrevenni. Az a gyanúnk, hogy a térhasználat folyamatos kell legyen, ez könnyen bizonyítható lenne, ha egy textúrás alapot tennénk a lovagok alá, hogy ott is érzékelhesse a plánokat a gép, ahol pont nincsenek tárgyak. De persze nem fogjuk kipróbálni.

Ha végül sikerült, egy skriptet kapunk, ezt lehet beágyazni a saját oldalunkra, de ami a videóállománnyal együtt működik csak, és mint már említettem sok felhőalkalmazás linkjén egyszerűen nem látszik a videó, vagy ha igen, akkor dinamikusan változik a link.

Lett volna még pár beállítás, de a fejem is megfájdult ettől a marhaságtól, ha tudom, mennyi macera, neki se fogok. Na jó, még egyet, hogy lássátok mennyire esetlegesen végzi a dolgát ez a DOF motor. Itt egyáltalán nem sikerült a plánokat észrevenni. Az a gyanúnk, hogy a térhasználat folyamatos kell legyen, ez könnyen bizonyítható lenne, ha egy textúrás alapot tennénk a lovagok alá, hogy ott is érzékelhesse a plánokat a gép, ahol pont nincsenek tárgyak. De persze nem fogjuk kipróbálni.

Click anywhere to adjust the focus.